고정 헤더 영역

상세 컨텐츠

본문

- 평균 검정이란 집단의 평균을 다른 집단과 비교하기 위한 가설 검정 방법으로 크게 z-검정, t-검정, 분산분석으로 나눌 수 있다.

- z-검정, t-검정은 비교 집단이 2개 이하일 경우 사용하며 분산분석은 비교 집단이 3개 이상일 경우 사용한다.

- z-검정은 모분산을 알고 있을 때 사용가능하며 t-검정은 모분산을 모를때도 사용 가능하다. 당연히 대부분의 경우 모분산을 모르므로 t-검정을 사용한다.

1. One sample t-test

한개 표본의 평균과 특정한 평균값을 비교 검증하는 방법입니다.

예를 들어 대한민국 모든 고등학교 2학년 학생의 지능이 100인지를 검증하기 위해 고등학교 2학년 500명을 무작위로 추출해 지능검사를 실시합니다. 지능 검사의 평균이 104일 때 4점 차이가 통계적으로 유의미한지 검증할 때 one sample t-test를 사용합니다.

분모는 표준오차(standard error)로 n은 표본의 크기인 500, σ는 표본의 표준 편차입니다. 분자는 104(표본 평균)에서 100(모집단의 평균)을 뺀 값입니다. 표본은 무작위 추출 고등학교 2학년 500명이며 모집단은 전국의 모든 고등학교 2학년입니다.

자유도 (degree of freedom)

엑셀이나 R같은 통계 프로그램으로 t-검정을 수행하면 자유도라는 것을 보게 될 것입니다. 일단 one-sample t-test를 했을 때라고 가정해봅시다. 그러면 자유도는 표본 집단의 크기에서 1을 빼면 됩니다. 자유도는 n-1이 되는 거죠.

그럼 자유도는 뭘까요? 자유도는 물리학이나 화학에서 쓰는 개념으로 "어떤 물체의 운동을 설명하기 위해 필요한 변수의 개수"로 정의됩니다.

그러면 통계학에서는 어떻게 적용될까요? 1,2,3이라는 숫자를 가지는 표본이 있다고 가정해봅시다. 이 표본의 평균은 2입니다. 누군가 1과 2를 선택하면 나머지 숫자 한개는 표본 평균 2를 맞추기 위해 무조건 3이 됩니다. 또 누군가 1과 3을 선택하면 표본 평균 2를 맞추기 위해서는 나머지 하나는 무조건 2가 됩니다.

즉, 표본의 평균을 아는 상태에서 자유롭게 정해질 수 있는 데이터의 수입니다. 실제로 표본의 평균을 안다면 마지막 한 개의 데이터는 무조건 정해져 있기 때문입니다. n-1까지는 표본에서 데이터를 무작위로 추출할 수 있지만, 마지막 한 개의 데이터는 이미 표본 평균이 정해져 있기 때문에 무작위로 추출할 수 없는 것입니다.

물리학이나 화학에 빗대어 보면 이미 어떤 물체의 운동 상태를 아는 상태(이미 표본의 평균을 아는 상태)에서 이 운동을 설명하기 위해 필요한 변수의 개수는 통계학적으로 보면 "표본의 크기가 n이면 이미 알고 있는 표본의 평균을 설명하기 위한 데이터의 개수는 n-1이다. 나머지 한개는 무조건 정해지기 때문에"라고 저는 해석했습니다. 혹시 틀린 부분이 있으면 댓글로 지적해주시면 감사합니다.ㅎㅎ

효과크기 (Effective Size)

효과크기라는 개념이 있습니다. 표본의 평균이 모평균과 얼마나 다른지 보는 것입니다. one sample t-test에서의 효과크기 공식은 아래와 같습니다.

예를 들어 30명의 학생들의 수학성적과 영어성적 평균이 각각 63.4, 57.13이고 이 성적평균이 65점과 통계적으로 유의미하게 다른지 검정을 한다고 가정해봅시다.

수학성적과 영어성적의 효과크기는 아래와 같습니다.

효과 크기가 0.2미만이면 작은 효과 , 0.5 수준이면 중간 효과, 0.8이상이면 큰 효과로 해석합니다.

수학성적 평균의 효과크기는 0.08로 0.2 미만입니다. 즉, 수학성적 평균인 63.4와 우리가 설정한 65점 사이에서는 사실상 차이가 거의 없다는 뜻입니다. 63.4나 65점이나 도토리 키재기다라는 뜻입니다. 하지만 영어성적 평균인 57.13과 65점 사이의 효과 크기는 0.5수준으로 꽤 큰 차이가 있습니다.

A/B테스트 시 효과크기도 중요합니다. 대부분 p-value가 0.05 수준 이하면 통계적으로 유의하다고 생각하는데 p-value는 표본의 크기를 늘리면 줄어듭니다. 그래서 표본 평균과 모평균과의 차이가 아주 적어도 통계적으로 유의미하는 결과가 나오게 됩니다. 하지만 만약에 아주 작은 평균 차이를 확인하기 위해 막대한 비용과 시간을 낭비하면 손해입니다. 그래서 A/B테스트를 할 때엔 효과크기도 중요합니다.

2. two sample t-test

두 표본 집단이 서로 다른 두 모집단에서 나왔는지를 알기 위해 두 집단의 평균을 비교합니다.

two sample t-test는 두 표본 집단의 분산이 등분산이냐, 이분산이냐에 따라 다른 검정 방법을 사용합니다.

그래서 먼저 등분산 검정을 실시합니다.

등분산 가정(왼쪽)과 이분산 가정(오른쪽)일 때의 t-검정통계량 공식

효과 크기

two sample t-test에서 효과크기

two sample t-test에서 효과크기는 "두 표본 집단 평균의 차이 / 추정된 표준편차" 이다.

분자는 바로 이해할 수 있지만 추정된 표준편차는 좀 어려운 개념이다. 추정된 표준 편차를 알기 위해서는 표본 평균 차이의 분포를 알아야 한다.

정규분포를 따르는 서로 다른 두 모집단에서 각각 표본을 추출해 표본 평균 차이를 구했다고 가정하자. 이 작업을 반복하면 다양한 평균 차이 값을 구할 수 있다. 이 때 두 평균 차이 분포를 아래의 그림과 같이 표현할 수 있다. 여기서 위 식에 있는 추정된 표준편차는 아래 그림에 있는 분포의 표준편차를 의미한다. 수식적으로는 두 표본의 합동분산이다.

여기서 효과 크기가 1이면 분자와 분모는 같은 값이 된다. 즉, 두 표본 집단의 평균 차이가 평균 차이 분포에서의 표준편차와 같은 뜻이므로 아래 그림과 같은 상황을 가정할 수 있다. 아래 그림은 두 모집단의 분포 형태이다. 위 그림의 빨간색 화살표와 아래 그림의 빨간색 화살표는 동일하다.

- 효과 크기 = 두 표본 집단의 평균 차이 / 추정된 표준편차 = 1

- 두 표본 집단의 평균차이 = 추정된 표준편차

효과 크기가 크면 두 집단이 겹치는 부분이 작아 두 집단을 서로 이질적인 것이고, 효과 크기의 값이 작으면 두 집단은 서로 겹치는 부분이 많아 동질적인 것이다.

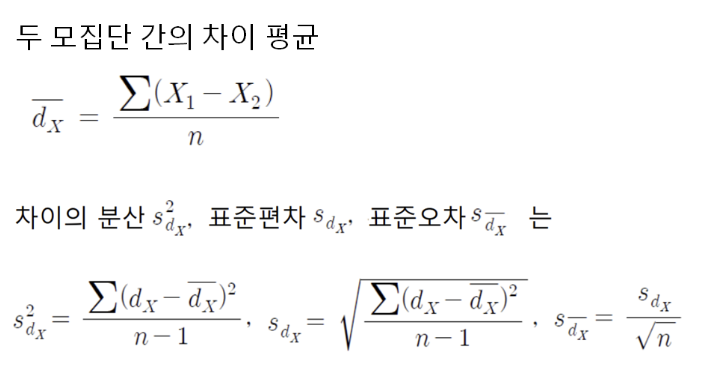

3. paired t-test

위의 two sample t-test는 서로 다른 두 모집단의 평균을 비교하는 가설 검정 방법이다. 하지만 동일 표본에 대하여 전/후 비교를 하고 싶을 때가 있다. 예를 들어 약의 효과나 금연의 효과를 알아보고 싶을 때가 있다.

paired t-test의 검정 통계량 수식

참고자료

https://brunch.co.kr/@linecard/670

Jamovi 의 이해 : 3. t 검증

자모비(Jamovi)는 SPSS의 공개 오픈 소프트웨어 버전입니다. 자모비 소프트웨어는 아래 사이트에서 다운로드할 수 있습니다. 이 글은 SPSS에서 사용법을 위주로 설명하여 배경 지식을 설명하지 못했

brunch.co.kr

효과 크기(Effect Size)의 의미와 필요성

1. 들어가며 기초 추론 통계 방법 중, 두 집단의 평균차이 검증(T-test)이 있다. 두 표본의 평균 차이가 모집단 차원에서도 있는 것인지 아니면 표본에서만 우연히 차이가 있는지 검증하는 방법이

diseny.tistory.com

'그로스 해킹' 카테고리의 다른 글

| Minimum Detectable Effect(최소 검출 가능 효과) (0) | 2022.11.19 |

|---|---|

| A/B 테스트 (2) | 2022.11.19 |

| MRR (0) | 2022.11.12 |

| CAC와 CPA의 차이점 (0) | 2022.11.08 |

| 공헌이익 (0) | 2022.11.07 |

댓글 영역